Google 的突破不是 GPU 的終點,而是算力需求新一輪爆發的起點。

每當 Google 發表新一代 TPU 晶片,市場總會響起一樣的聲音:

TPU 能訓練出更強大的模型、更便宜、更省電,輝達(NVIDIA)似乎離「吃鱉」不遠。這種論調在過去幾週再次出現,特別是當 Google 展示自家模型 Gemini 3.0 Pro 的強大時,許多人急著宣告 GPU 時代結束。

但實際情況可能正好相反。Google 的領先不但沒有削弱輝達的地位,反而在結構上成為輝達的大利多。原因不在晶片,而在於這場競賽本身再次證明:「Scaling Law」仍然有效。

■ Scaling Law 的續命,是輝達最好的消息

Google 在最新一代模型中證明,只要增加訓練規模,模型效能依然能持續提升。這代表「投入更多算力就能產生更好 AI」的邏輯仍成立。這一發現的意義遠超技術層面 – 它重新啟動了整個市場對算力的信心。

一旦 Scaling Law 被驗證,所有想追上 Google 的科技巨頭都別無選擇,只能加碼算力投入。微軟、亞馬遜、Meta、Anthropic、OpenAI 等公司沒有 Google 那樣成熟的自研晶片與垂直整合能力,唯有依靠輝達的 GPU 才能快速擴張訓練與推論能力。

換言之,Google 的技術突破不會削弱 GPU 市場,反而會刺激整體 GPU 採購。輝達賣的不只是晶片,而是算力擴張的「通用通道」- 只要產業還相信規模帶來優勢,輝達的需求就不會減少。

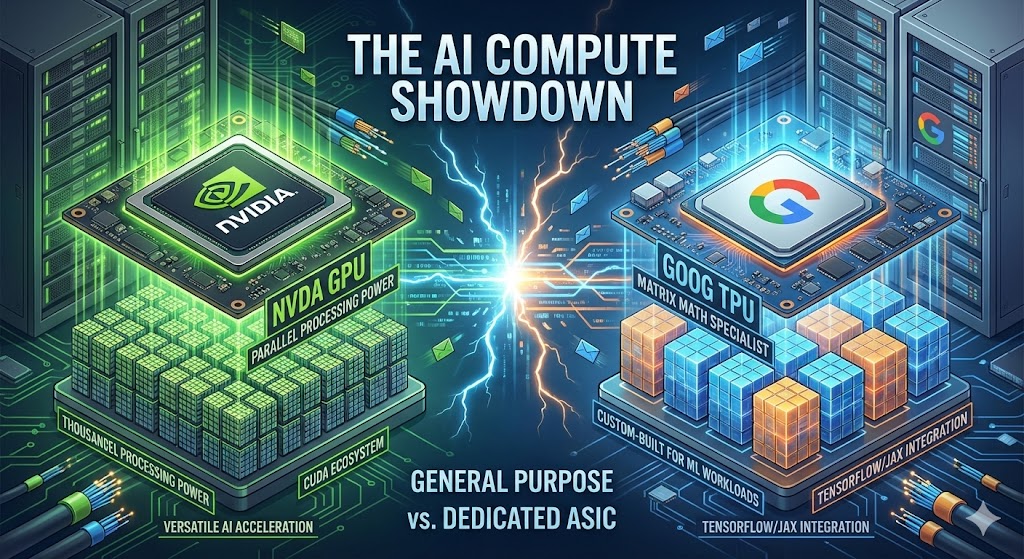

■ 外界誤解了 TPU 與 GPU 的效率比較

外界對 TPU 與 GPU 的比較,經常停留在單顆晶片的價格與功耗上。這樣的比較方式忽略了 AI 系統的本質:最終衡量單位不是瓦數,也不是美元,而是「每單位電力能產出的 token 數」——也就是生產效率。

從單顆晶片的理論數據來看,Google 的 TPU v6e 在 FP16 精度下提供 926 TFLOPS 的算力,而輝達的 GB200 約為 5000 TFLOPS。若只看每瓦效能(每瓦 TFLOPS),TPU 以 2.64 優於 GPU 的 1.85,效率高出約 42%。表面上,TPU 看似更效率更高更划算。

但這種比較忽略了實際應用的精度設定。FP16 已非主要推論模式,市場真正的主流是更低精度的 FP4 或 FP8。輝達的 GPU 可支援到 FP4,而 TPU 目前僅支援至 FP8 或 INT8。這一差異在推論效率上產生了反轉:在相同耗電下,輝達系統能產出約 40% 更多的 token。

也就是說,若以「AI 工廠」的角度衡量 – 每單位電力所能生成的輸出量,GPU 的系統效率並不輸 TPU。當整個產線以「token 產出」為核心指標時,輝達的整體性價比反而更高。

■ 資料中心的現實:空間、能耗與收益的經濟平衡

若將比較範圍從單顆晶片擴展到資料中心層級,輝達的優勢更為明顯。GPU 的運算密度更高,在同樣空間內能塞進更多算力,對租金與冷卻成本昂貴的雲端機房而言,這是關鍵的經濟因素。

假設一個資料中心擁有 100 個機櫃,若全部配置 TPU v6,在 FP16 精度下可達一定算力輸出;但若改裝成輝達 GB200,在相同空間與精度下,能產出約三倍的 token 數量,耗電則增加約四倍。然而,GB200 還能降低精度至 FP4,這讓 token 產出進一步提升至六倍,而耗電仍維持四倍水準。

結果是:在同一單位耗電條件下,使用輝達 GPU 的資料中心能比 TPU 機房多產出約 50% 的 token。

更重要的是,AI 推論的 token 銷售是「正毛利」的業務。每多消耗一倍電力,就意味著多創造一倍收入與更高的邊際獲利。從經濟效率的角度看,空間與能耗的限制下,填滿輝達 GPU 的資料中心,仍是更高報酬的投資組合。

■ GPU 雖貴,但整體性價比不低

的確,GPU 單價更高、耗電更多,但若以系統運行效率與產出計算,整體「每 token 成本」並不比 TPU 差。更重要的是,GPU 的通用性與軟體生態 – CUDA、TensorRT、以及龐大的開發者工具鏈,讓它在非 Google 的世界中,仍是不可取代的基礎設施。

TPU 是為特定架構與內部工作流程最佳化的封閉系統;而 GPU 是所有其他雲端供應商與模型公司的開放平台。這種「可擴展性與通用性」才是 GPU 的真正價值來源。當 AI 生產活動從單一公司內部實驗室擴散到全球雲端市場時,輝達仍然是唯一能即時擴充的算力供應者。

■ Google 的進展不是輝達的危機,而是市場的強心針

每一次有公司展示更高效的模型訓練,都會觸發市場對「AI 繼續擴張」的信心循環。Google 這次的成功,不是 GPU 的終章,而是下一輪算力投資的開場。

對輝達而言,這意味著更多的 GPU 將被部署在全球資料中心,用來支撐所有追趕者的野心。AI 產業最終不會變成「誰的晶片最省電」的比賽,而會是「誰能最有效率地擴張算力」的比賽。

而在這場比賽中,輝達依舊是唯一能讓整個產業「即刻放大」的基礎設施提供者。