【AI 會殺死軟體嗎?從第一性原理看未來的軟體產業】

過去兩個月,美國科技股中的軟體板塊出現明顯修正,即使像 Palantir 這樣交出高成長財報的公司,股價也未能帶動整體板塊氣氛。市場的焦點只有一個:當 AI Agent 開始能寫程式、操作系統,甚至直接給出答案時,軟體還有存在的必要嗎?

從 Claude Code、各類法律 AI 插件,到能自動完成任務的 Agent 工具,投資人開始懷疑,過去需要軟體才能完成的工作,未來是否只要對 AI 說一句話就能解決。如果 AI 能直接給答案,甚至替你打造一套更符合需求的系統,那軟體公司還剩下什麼價值?

這是一個巨大問題。也是過去一年來,整個科技產業與投資圈反覆思考的核心議題。

■ 從第一性原理看:軟體與 AI 的本質差異

要回答「AI 會不會消滅軟體」,必須先回到更根本的問題:軟體到底是什麼?

從第一性原理來看,軟體的本質,是把人類會重複執行的行為固定化與自動化,讓事情做得更快、更準確。手動抄寫一段文字一百次,既慢又容易出錯;用軟體複製一百次,幾乎瞬間完成且不會出錯。手動計算一串數字,可能算錯;計算機軟體則可以在毫秒內完成。排序、計算、轉換、記錄,這些本來屬於人類的動作,一旦被寫成程式,就能用最有效率、最可預測的方式反覆執行。

AI Agent 的本質卻完全不同。大型語言模型是推理式與機率式的系統,它擅長處理模糊問題、跨領域任務與非結構化情境。這讓 AI 看起來像一個超級人類,可以解決過去需要多個專業才能處理的問題。但在需要大量重複運算、確定性結果與高效率的場景中,AI 並不是最佳工具。

這種差異在效率與確定性上特別明顯。讓 AI Agent 去做一個簡單的算術,例如 125536 加上 4458,它當然可以做出正確答案,但過程其實是透過語言模型推理完成,背後消耗的運算資源與能源,遠高於一個簡單的計算機程式。對人類來說,這差異可能感覺不大,但如果放大到整個社會規模,當未來有數以兆計的運算需求時,若全部都交給 AI 用推理完成,成本與能源效率都會變得極差。

另一方面,當一套軟體完成後,只要沒有程式錯誤,在相同輸入條件下,它的輸出結果是完全可預測的。AI Agent 則無法做到這種程度的確定性,因為它的本質是機率預測,即使正確率很高,如達到 99.99% 的正確率,也仍然會有 0.01% 機率會在簡單問題上出錯。

軟體勝過 LLM AI 的地方,就在於效率性與確定性。

如果想像一個極端情境:假設未來世界完全沒有傳統軟體,只剩下大量 AI Agent 在運作。當這些 Agent 面對人類交付的海量運算需求時,最合理的演化路徑會是什麼?很可能不是讓 AI 每次都重新推理,而是先把那些重複性高、邏輯明確的任務寫成固定程式,再讓 AI 去操作這些程式。

就像人類在需要移動重物時,會發明輪子一樣。如果使用輪子更有效率,要嘛直接使用現成的輪子,要嘛自己把輪子造出來。軟體在資訊世界裡,正扮演這樣的角色。

從這個角度來看,軟體這一層並不會因為 AI 的出現而消失。相反地,在一個運算需求爆炸的時代,軟體作為效率與確定性的基礎層,反而會變得更加重要。AI Agent 很可能不斷進化,但它們最終仍會選擇操作軟體,來達到整體系統最佳的效率。

■ 即使 AI 能寫系統,企業也不會放棄軟體

很多人直覺會問一個問題:如果 AI 已經能自動寫程式、生成系統,甚至可以依照企業需求客製化開發,那企業為什麼還需要去買 SaaS?直接讓 AI 做一套專屬系統,不是更便宜、更貼近需求嗎?

這個問題表面上看起來是技術問題,但本質上其實是經濟與治理結構的問題。企業購買軟體,從來不只是為了少寫幾行程式碼,而是在外包一整套責任、制度與風險管理機制。

當一家企業採用成熟軟體時,本質上是在外包四件事情:效率、結果的確定性、安全性,以及系統完整性。

第一點的效率,以及第二點的確定性,上面已經提過了。但對於企業來說,還有第三點安全性,以及第四點的系統完整性。

第三是安全性。企業系統中通常包含大量敏感資料,例如客戶資訊、交易紀錄、內部文件與商業機密。成熟軟體廠商會投入大量資源在資安防護、漏洞修補、權限管理與合規認證上,並提供長期的安全更新與支援。當企業改用 AI 自行開發系統時,這些安全責任就全部回到企業自己身上。對個人或小型團隊而言,這可能還可以接受,但對大型企業或政府機構來說,這種風險幾乎無法承擔。

第四點,則是系統完整性。企業運作涉及大量細節與隱性知識,例如例外處理、法規要求、稽核機制與跨部門流程。這些 know-how 往往是軟體廠商在多年服務不同客戶過程中累積下來的。一套成熟的企業軟體,背後其實包含了整個產業的實務經驗與制度設計。當企業自行用 AI 開發系統時,很容易只覆蓋「看得到的需求」,卻忽略那些關鍵但不明顯的流程細節。

有人可能會說,那企業可以再用另一個 AI 來檢查系統,甚至建立多層 AI 驗證機制。問題在於,企業的信任並不來自於「有另一個 AI 說這套系統沒問題」,而是來自於有人願意對結果負責。當事情出錯時,企業需要一個可以追究責任、提供支援、甚至承擔法律義務的對象,而不是一個模型輸出的建議。

因此,企業很可能最後還是要找人類專家來審核與背書。當企業走到這一步時,整個流程其實已經變成自己組建一個軟體團隊,負責開發、測試、資安、法遵與長期維護。這本質上就是在自己扮演軟體公司的角色。

從規模經濟來看,這種做法往往比直接購買成熟軟體更昂貴,也更難控管風險。軟體公司可以把同一套系統賣給成千上萬家企業,分攤開發與維護成本;單一企業若自己打造整套系統,則必須獨自承擔所有成本與責任。

因此,對多數企業而言,把效率、成果確認、安全性與流程完整性外包給專業軟體公司,依然是更合理、也更具經濟效益的選擇。AI 可能會改變軟體的使用方式與介面,但企業對於可驗證、可負責、可長期維運的軟體需求,並不會因此消失。相反地,這種需求在 AI 時代可能只會變得更加重要。

■ 軟體將變成 AI 的共通操作層

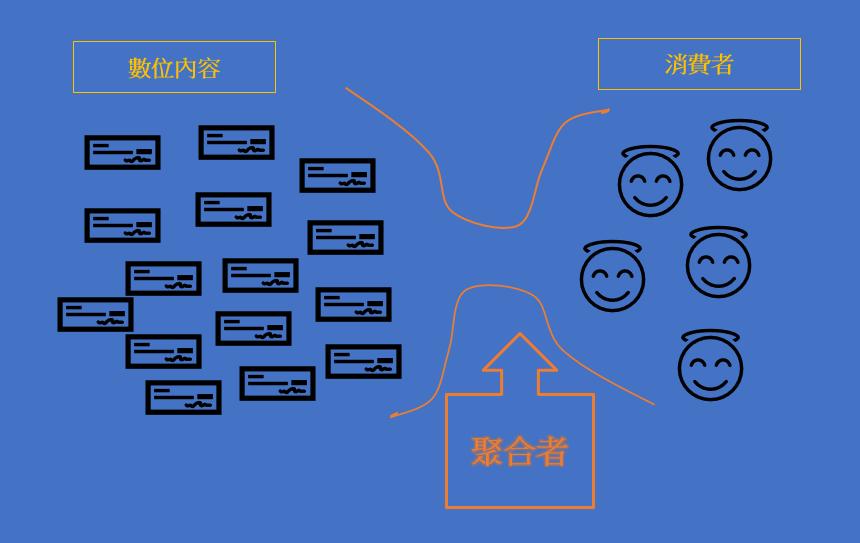

未來的企業系統,很可能出現一種新的分工結構。核心功能與關鍵流程由軟體負責,確保效率與確定性;而在操作層與客製化層面,AI Agent 會扮演更重要角色。

這種結構可以類比為工廠裡的機械手臂與人形機器人。機械手臂擅長重複、精準的動作,因此負責核心生產;人形機器人則負責彈性流程與協調工作,但不會去取代機械手臂最擅長的任務。

在軟體世界中,資料庫、交易系統、財務引擎,就像這些機械手臂。AI Agent 則像人形機器人,負責理解需求、整合流程、產生客製化結果。兩者的協作,反而是整體效率最高的模式。

這也意味著軟體的角色會轉變。未來軟體不一定是「最聰明的地方」,而是「所有人與 AI 都能確認共識的地方」。軟體成為一個可驗證、可監督、可追溯的操作層,讓整個系統運作保持穩定。

■ 效率與客製化的重新平衡

過去幾十年,企業在軟體選擇上一直面臨一個取捨。標準化軟體可以提供高效率與低成本,但功能只能滿足大多數客戶的需求;自行開發系統則可以高度客製,但成本高、維護困難。

AI 的出現,正在改變這個長期存在的結構。未來的模式可能是,核心軟體維持標準化的高效率能力,而 AI 在上層負責客製化組裝與操作方式。

這種模式可以用「積木」來理解。過去軟體公司交付的是一個已經拼好的積木成品,客戶只能選擇有限幾種版本。未來軟體公司提供的是一盒高品質積木,而 AI 會根據每個客戶的需求,把這些積木拼成最適合的形狀。

這樣的分工,讓企業不再需要在效率與客製化之間做極端選擇。核心系統仍然穩定高效,而 AI 提供接近客製開發的彈性,整體效率反而更高。

■ 結論:AI 不會消滅軟體,只會重新分配價值

AI Agent 的崛起,確實會讓軟體產業出現劇烈變動。一部分以操作介面為核心價值、功能單一、或依賴席次訂閱的軟體,很可能逐步失去市場。但從第一性原理來看,軟體作為效率與確定性的執行層,並沒有被取代的理由。

未來的世界,不會是 AI 取代軟體,而是 AI 與軟體形成新的分工體系。核心功能由軟體提供,確保效率與穩定;客製化與操作層,則由 AI 負責。部分軟體公司會逐步淡出舞台,另一部分則會成為整個 AI 時代的基礎設施。

所以,真正值得關心的問題,並不是軟體會不會消失 (我們很確定不會),而是哪一種軟體能在 AI 世界裡成為不可或缺的底層結構,隨著 AI 浪潮一起變得更加壯大。